· Nolwen Brosson · Blog · 9 min read

Ace : le robot IA qui bat des joueurs de tennis de table

Tout le monde a déjà vu un robot qui joue au tennis de table. Mais aucun robot n’était jusqu’à présent capable de battre de bons joueurs sur un match entier. Ace, c’est différent.

Une équipe de chercheurs a publié dans Nature le 22 avril 2026 une étude sur ce système. Ils l’ont fait jouer contre cinq joueurs de niveau confirmé et deux professionnels, dans des conditions proches du jeu officiel. Ace a gagné trois matchs sur cinq contre les joueurs confirmés. Il a perdu contre les deux pros.

Le robot n’atteint donc pas encore le très haut niveau, mais il démontre qu’il est capable d’être compétitif dans des conditions proches du réel.

Pourquoi le tennis de table est un problème difficile pour un robot

Pour un humain, le tennis de table semble naturel. On voit la balle, on anticipe, on bouge, on frappe. Mais pour un robot, il y a beaucoup de complexité technique.

Entre deux touches de balle, il peut y avoir moins d’une demi-seconde. Et il y a aussi la notion d’effet. Avec les rotations, la balle peut atteindre 1 000 radians par seconde, ce qui modifie sa trajectoire, son rebond sur la table et son comportement au contact de la raquette.

Autrement dit, Ace doit répondre à trois questions, très vite :

Où est la balle ?

Quelle est la quantité d’effet ?

Quel mouvement faut-il faire pour la renvoyer sans se tromper ?

Et il doit faire tout cela en temps réel, avec un humain en face qui essaie justement de le mettre en difficulté.

Comment Ace voit la balle

Ace utilise deux types de vision.

Le premier système sert à repérer la position de la balle dans l’espace. Pour cela, le robot s’appuie sur neuf caméras classiques placées autour du terrain. Ces caméras permettent de reconstruire la position de la balle en 3D, un peu comme nos deux yeux permettent à notre cerveau d’estimer la profondeur.

Dans le cas d’Ace, le système localise la balle à 200 Hz, soit 200 mesures par seconde, avec une erreur moyenne de 3 millimètres et une latence moyenne de 10,2 millisecondes. La latence, c’est le délai entre le moment où quelque chose arrive et le moment où le système peut l’utiliser.

10,2 millisecondes, c’est évidemment très court. Mais dans un sport où tout se joue en quelques centaines de millisecondes, chaque milliseconde compte.

Le second système sert à mesurer l’effet de la balle. Pour cela, Ace utilise des caméras événementielles. Contrairement à une caméra classique qui prend des images complètes, comme une succession de photos, une caméra événementielle fonctionne autrement : elle ne transmet que les changements détectés dans la scène. C’est très utile quand un objet bouge vite, parce qu’on évite de traiter des images entières inutilement.

Ce type de caméra est particulièrement adapté au tennis de table, car l’effet est difficile à mesurer avec des caméras classiques. Une étude sur l’estimation de l’effet au tennis de table avec une caméra événementielle explique justement que la rotation est essentielle, mais difficile à observer directement, surtout quand la balle va vite.

Ace combine ces capteurs avec des systèmes de suivi qui gardent la balle dans le champ de vision, puis estime la rotation grâce à deux méthodes : un réseau de neurones convolutif, ou CNN, pour obtenir une réponse rapide, et une méthode plus précise mais plus lente appelée maximisation de contraste.

Les estimations de rotation sont ensuite envoyées au système de contrôle à une fréquence variable d’environ 400 à 700 Hz.

En clair : Ace ne se contente pas de voir la balle. Il essaie aussi de lire son effet, comme le ferait un bon joueur humain.

L’apprentissage par renforcement : comment Ace apprend à jouer

Le cœur d’Ace repose sur l’apprentissage par renforcement, ou reinforcement learning.

L’idée est simple à comprendre. On place un agent dans un environnement. Il tente une action. Il reçoit une récompense si l’action est bonne, une pénalité si elle est mauvaise, puis il recommence. Après beaucoup d’essais, il apprend quelles actions augmentent ses chances de réussir.

Dans le cas d’Ace, l’agent est le système de contrôle du robot. L’environnement, c’est une simulation de tennis de table. L’action, c’est le mouvement que le robot doit produire pour frapper la balle. La récompense dépend de la qualité du retour.

À noter que les politiques de contrôle d’Ace ont été entraînées entièrement en simulation. Le robot n’a donc pas eu besoin de taper des millions de balles dans le monde réel pour apprendre.

Les chercheurs ont créé des modèles physiques, ajouté du bruit pour simuler les imperfections des capteurs, puis entraîné plusieurs politiques capables de produire différents types de coups.

C’est un détail essentiel. Dans beaucoup de projets robotiques, le problème n’est pas seulement d’apprendre. C’est de transférer ce qui a été appris en simulation vers le monde réel. On appelle cela le sim-to-real, ou le passage de la simulation au réel.

Ace fonctionne parce que son apprentissage a été conçu pour supporter cette différence.

Actor-critic : le professeur et le joueur

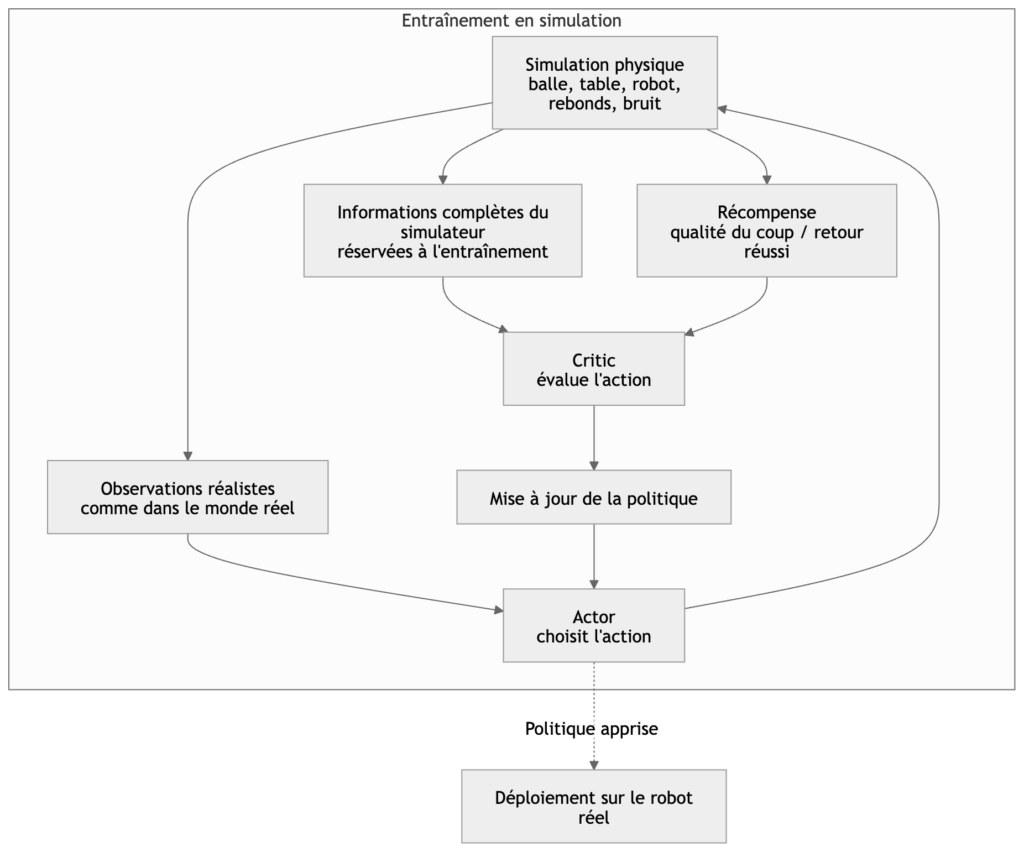

L’architecture utilisée pour entraîner Ace est appelée actor-critic asymétrique. Le terme peut faire peur, mais le principe est assez intuitif.

Imaginez deux rôles.

L’actor, c’est le joueur. C’est lui qui décide quoi faire pendant le match. Il reçoit des informations imparfaites, comme dans le monde réel : position estimée de la balle, rotation estimée, état du robot.

Le critic, c’est le professeur pendant l’entraînement. Lui a accès à des informations plus propres, directement issues de la simulation. Il peut donc mieux juger si l’action choisie était bonne ou mauvaise.

Cette approche est connue en robotique. Dans un papier sur l’actor-critic asymétrique pour l’apprentissage robotique, des chercheurs expliquent qu’on peut utiliser les informations parfaites du simulateur pour entraîner un meilleur critic, tout en gardant un actor capable d’agir avec des observations imparfaites dans le monde réel.

Pendant l’entraînement, le professeur aide le joueur à progresser. Mais pendant le match, seul le joueur agit. C’est pratique, car le robot apprend avec une aide précise en simulation, tout en restant capable de fonctionner avec des données imparfaites dans le réel.

C’est l’un des choix techniques qui permet à Ace de ne pas être seulement bon dans un simulateur.

Comment Ace décide de son geste

Pendant un échange, Ace interroge sa politique de contrôle toutes les 32 millisecondes, soit 31,25 fois par seconde. À chaque fois, le système reçoit l’état de la balle, l’état du robot et l’historique récent des mesures. Il produit ensuite une action.

Mais cette action n’est pas directement envoyée au moteur comme un ordre brut.

Elle est transformée en une petite trajectoire de 32 millisecondes. Ensuite, un autre système vérifie que le mouvement est faisable et qu’il ne provoque pas de collision avec la table ou avec le robot lui-même.

Si le mouvement est jugé dangereux, Ace exécute une trajectoire de repli, appelée reset trajectory. Le système doit donc être performant, mais aussi sûr.

Le hardware : le corps du robot compte autant que l’IA

Ace ne serait rien sans son corps mécanique. Le robot a été conçu avec huit degrés de liberté : deux articulations prismatiques et six articulations rotatives.

Un degré de liberté, c’est une manière indépendante de bouger. Plus un robot a de degrés de liberté, plus il peut produire des mouvements variés.

Les chercheurs expliquent que cette configuration correspond au minimum nécessaire pour jouer des coups compétitifs : contrôler la position de la raquette, son orientation, ainsi que la vitesse et la direction de la frappe.

Ace a été conçu pour jouer sur une vraie zone de table. Son bras peut donc atteindre les zones qu’un joueur professionnel utilise pendant un échange.

Mais le robot doit aussi bouger au bon moment. Ses moteurs sont synchronisés toutes les millisecondes, et même lorsqu’il va vite, le délai entre l’ordre envoyé et le mouvement réel reste inférieur à 5 millisecondes.

L’IA peut donc choisir le bon coup, et le corps du robot peut l’exécuter quasi immédiatement.

Les résultats : Ace a un bon niveau, mais il est encore loin d’être imbattable

Les tests ont eu lieu en avril 2025. Ace a affronté cinq joueurs avec plus de dix ans d’entraînement, puis deux joueurs professionnels de la ligue japonaise T.League.

Les matchs ont été disputés avec des balles officielles, une aire de jeu de taille olympique côté joueur humain, et sans simplifications majeures des règles habituelles.

Ace a gagné trois matchs sur cinq contre les joueurs confirmés. Il a perdu ses deux matchs contre les professionnels.

Ce qui est intéressant, c’est la manière dont Ace gagne. Les humains marquent surtout avec des coups rapides et beaucoup d’effets. Ace, lui, gagne plutôt par régularité. Il conserve un taux de retour supérieur à 75 % jusqu’à 450 radians par seconde de rotation.

Ace n’est donc pas seulement une machine qui frappe fort. C’est une machine qui lit, contrôle et remet la balle avec une constance impressionnante.

Ce que Ace nous apprend sur l’IA physique

Ace rappelle une différence fondamentale entre l’IA numérique et l’IA physique.

Dans un jeu vidéo ou un jeu de plateau, l’IA reçoit un état propre : position des pièces, score, règles fixes. Dans le monde réel, l’état est toujours incertain. Les capteurs ont du bruit. Les objets glissent, tournent, rebondissent. Les humains changent de stratégie. Le temps de calcul est limité.

Le tennis de table est donc un benchmark intéressant, car il oblige à résoudre plusieurs problèmes en même temps :

- perception rapide

- prédiction physique

- prise de décision

- contrôle moteur

- adaptation à l’adversaire

L’article conclut que les techniques utilisées pour Ace pourraient s’appliquer à d’autres domaines où des robots doivent interagir vite et précisément avec des humains, par exemple dans la robotique de service ou la production industrielle.

Si un robot peut réagir à une balle rapide et imprévisible, il peut aussi progresser dans des environnements industriels qui changent en permanence.

Les limites actuelles d’Ace

Contrairement au go ou aux échecs, les robots ne peuvent pas encore battre les meilleurs joueurs au tennis de table.

Ace reste aussi un système spécialisé. Il joue dans un environnement instrumenté, avec plusieurs caméras installées autour du terrain et un robot conçu uniquement pour cette tâche.

L’article souligne un dernier défi important : modéliser le comportement humain. Pour gagner un match, il ne suffit pas de renvoyer la balle. Il faut comprendre le jeu de son adversaire, varier les coups, anticiper ses choix et exploiter ses faiblesses.

C’est peut-être la prochaine étape : créer un robot capable de mettre en place de vraies stratégies.