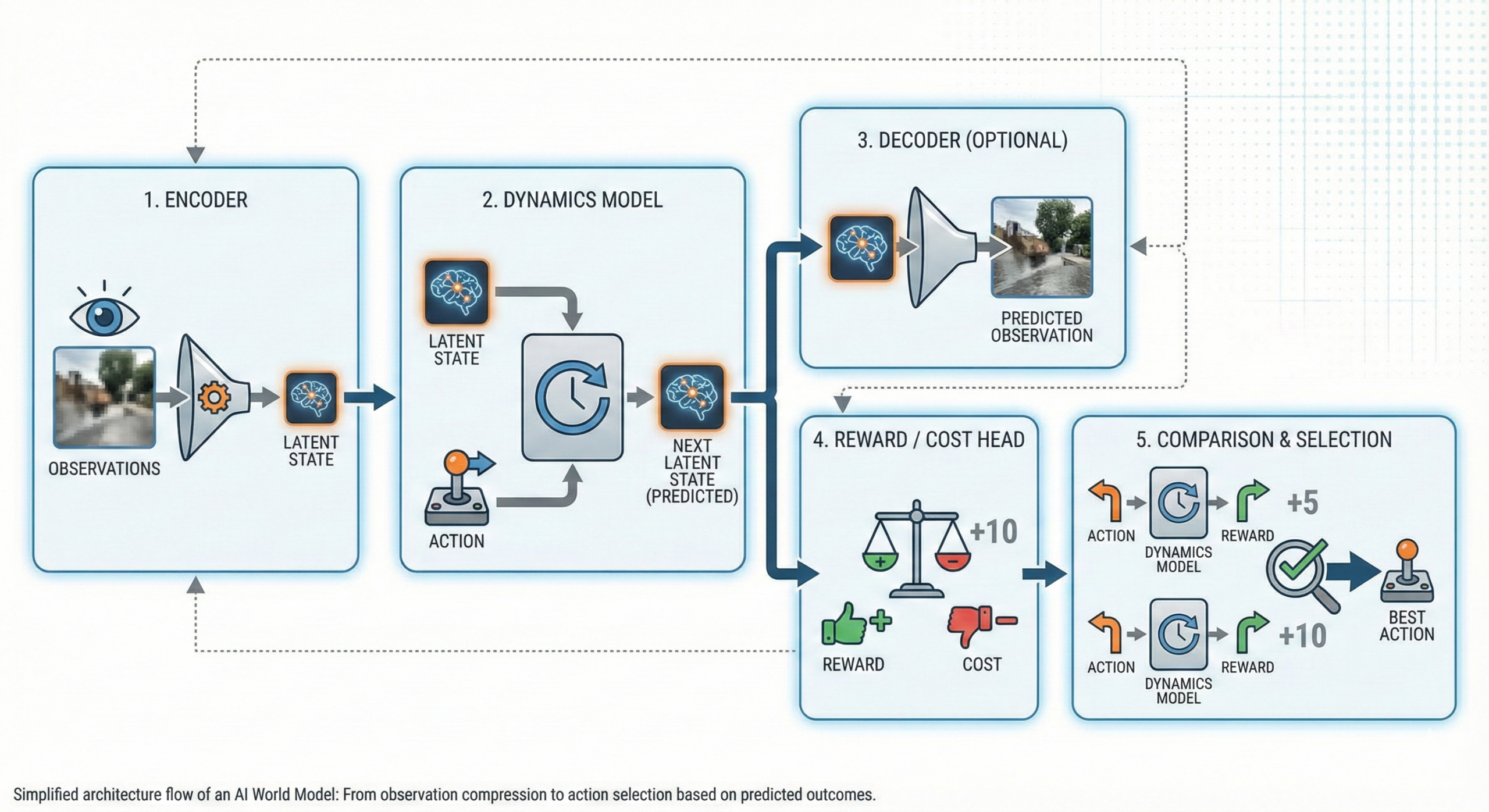

Local-first : l’IA quitte le cloud et tourne sur votre PC grâce aux NPU

Pendant des années, “faire de l’IA” voulait dire “envoyer des données à un serveur” (Microsoft, Google, OpenAI et consorts). C’était logique : les modèles étaient volumineux, les GPU coûteux, et la latence acceptable. Mais c’est en train de changer. Le matériel a rattrapé le logiciel, et pas seulement via les GPU : les NPU (Neural […]